No es solo cuestión de detectar “bots”. El uso de desinformación, spam, cuentas inauténticas y llamados peligrosos diferencia una campaña digital espontánea de una operación de influencia maliciosa

Las redes sociales suelen ser vistas como un espacio de confrontación informativa, especialmente cuando ocurre o se avecina un hecho político importante. Mediante etiquetas y mensajes a favor o en contra, distintos actores generan conversación en redes sociales sobre temas de interés, y otros se esfuerzan por posicionar narrativas sin que, a menudo, se revele quién está detrás. En ese ambiente polarizado, son frecuentes las acusaciones cruzadas sobre el uso de “bots” y cuentas falsas para manipular la conversación pública.

Pero no todo lo que parece una conversación impulsada por cuentas “bots” –o cualquier tipo de cuenta inauténtica– lo es, ni usar cuentas falsas es la única manera de manipular a las redes sociales.

Las estrategias de influencia pueden incluir cuentas reales, grupos coordinados, comunidades militantes o incluso esfuerzos espontáneos que terminan pareciéndose a una operación digital. ¿Cómo saber entonces cuándo estamos frente a una movilización digital legítima y cuándo se trata de una acción organizada para engañar o distorsionar el debate público?

¿Qué separa la protesta de la toxicidad?

Nahum Fernández —jefe de Gobierno del Distrito Capital y coordinador de Movilización del Comando de campaña de Nicolás Maduro para las elecciones presidenciales en 2024— ofreció el 12 de marzo de 2025 una explicación oficialista de una supuesta “guerra comunicacional” que ocurre día a día en la Venezuela digital: el chavismo, asegura, se defiende de “cientos o miles” de bots opositores que pretendían socavar su proyecto en redes sociales.

“Sabemos que son bots, escritos por una persona metida en una computadora a través de mil teléfonos… Eso no puede afectarnos porque nosotros, en vez de bots, vamos a tener seres humanos reales, revolucionarios”, declaró. Y añadió: “Solo esta estructura con el ‘Siscom’… empezó a generar una unidad para empujar, comunicacionalmente, el fenómeno que estaba pasando”.

Hasta ahora no existe evidencia técnica que demuestre que –al menos recientemente– la oposición venezolana, o el mismo chavismo, emplea redes automatizadas a gran escala. Lo que sí se ha documentado en Venezuela es el uso de tácticas, técnicas y procedimientos de manipulación de redes sociales, que han sido impulsados por el propio oficialismo y, en algunas ocasiones, por algunos actores dentro de la oposición venezolana.

El problema, sin embargo, va más allá de la mera presencia de cuentas automatizadas, o “bots”, que impulsan narrativas en línea.

Para evaluar la manipulación en redes sociales no basta con analizar la actividad de cuentas anómalas (“bots”, cuentas con comportamientos similares a “bots” y “trolls” o cualquiera que sea la nomenclatura de moda). También es necesario examinar la intencionalidad con la que se despliegan las campañas, las distintas técnicas de manipulación de plataformas –entre ellas el spam– y, además, considerar la existencia de redes de cuentas falsas que se atribuyen a un actor cuando en realidad son operadas por otro.

Revisamos algunos principales episodios de campañas digitales inauténticas desplegadas en desde 2019 para distinguir una campaña digital legítima en línea de una operación de influencia maliciosa y explicar por qué la etiqueta “bot” resulta insuficiente para entender la disputa informativa.

Oh, la humanidad

Una campaña digital legítima está impulsada por cuentas reales y personas que se agrupan y coordinan una campaña en línea para reclamar diversas exigencias de forma coordinada.

Esta forma de protesta está protegida por el derecho a la libre expresión y a la organización ciudadana. Las plataformas digitales también fomentan este tipo de movilización, siempre que no impliquen la diseminación en línea de desinformación, contenido de baja calidad o “spam”, discurso de odio o se basen en actividad generada por cuentas falsas.

En países autoritarios en los cuales hay episodios recientes de represión o vigilancia contra activistas, periodistas o ciudadanos —como Venezuela, Cuba, Nicaragua o El Salvador—, muchas personas recurren al anonimato digital para protegerse y seguir ejerciendo su derecho a la protesta en línea.

En escenarios como estos, el uso de cuentas anónimas –cuyo operador humano no es conocido, ni declarado explícitamente– no implica necesariamente que se trate de cuentas “bots”, “trolls” o falsas. No son más que un recurso de autoprotección y, muchas veces, la única vía para seguir expresándose sin exponerse a represalias.

El anonimato, por sí solo, no deslegitima la movilización. Lo hace cuando la conversación es impulsada por redes de cuentas demostrablemente inauténticas —creadas para engañar o que actúan de forma coordinada o automatizada— o cuando se emplean técnicas que distorsionan el debate público. En entornos restrictivos, proteger la identidad resulta válido mientras no se utilice para difundir discursos de odio, desinformación o ataques personales.

Las campañas “maliciosas”

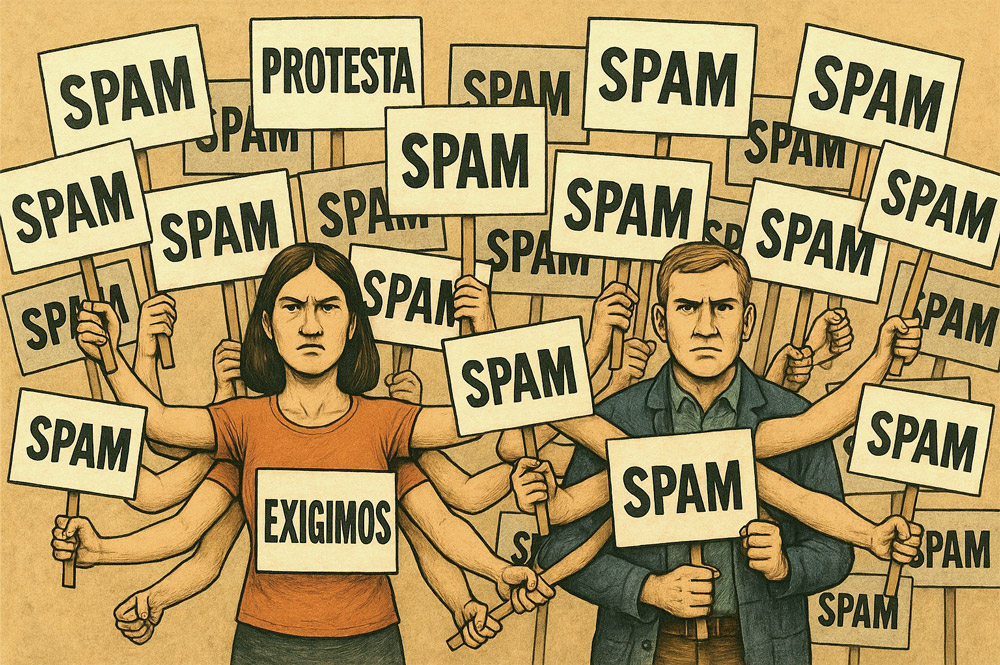

La calidad del contenido es uno de los tres factores clave que pueden determinar si una campaña legítima impulsada por personas reales se convierte en una operación de influencia “maliciosa”. La publicación repetitiva y automática de “spam” o contenido de baja calidad para inundar las redes sociales con narrativas específicas. es una clara señal de intencionalidad maliciosa. Cuando la prioridad es saturar las plataformas en lugar de dialogar, se cruza el umbral de la manipulación.

En Venezuela, por ejemplo, la red “Tuiteros de la Patria”, un grupo de cuentas pro oficialistas que inundó X (antes Twitter), publicaba una gran cantidad de mensajes muy similares o propaganda repetitiva sin valor, —prácticamente “lo mismo”— para proyectar una falsa popularidad en las etiquetas promovidas por el Ministerio de Comunicación e Información.

Algo similar ocurre cuando unos pocos usuarios, usando cuentas anónimas o no, inundan el espacio digital con una gran cantidad de mensajes de baja calidad. La inundación de espacios digitales con “spam” es una técnica para distorsionar la percepción pública y amplificar artificialmente una narrativa.

Otra clave para detectar campañas coordinadas que podrían formar parte de operaciones de influencia maliciosas es el uso de desinformación.

Cuando las cuentas involucradas difunden bulos, desinformación, e incluso contenidos satíricos basados en engaños sobre un tema específico, buscan confundir a los lectores sobre un hecho real. La implementación de desinformación no solo genera contenido de baja calidad, sino que también daña la integridad de la información en internet y en redes sociales y lesiona el derecho a sus usuarios a estar verazmente informados.

Cuando las campañas coordinadas en redes sociales están siendo impulsadas por una gran cantidad de cuentas que publican contenido repetitivo —incluso si ese contenido no es desinformación ni odio— y se puede demostrar que están automatizadas, hablamos que estamos frente a una red de cuentas “bots” o una “botnet”.

Una “botnet” puede generar muchos contenidos en línea, pero pertenece a una persona o a un grupo de personas. Algunos ejemplos de redes de cuentas bots son una red con más de 500 cuentas que identificamos en Cazadores de Fake News como Botnet-GL –que amplificó contenidos del ex presidente ecuatoriano Guillermo Lasso, en 2022– o una red de 6000 “Pornobots” avistada en 2021.

A veces las campañas en redes sociales se presentan como auténticas, legítimas y pacíficas. Sin embargo, cuando las cuentas que las impulsan resultan ser inauténticas —ya sean bots u otros perfiles ficticios— surge un problema de transparencia. Si estas redes permanecen activas y continúan promoviendo mensajes, pasan a constituir una operación de influencia maliciosa.

Demostrar la inautenticidad exige analizar varios patrones en conjunto: fechas de creación agrupadas, biografías o avatares muy similares, mismos patrones de seguidores, sincronía en la publicación o contenidos prácticamente idénticos. Solo cuando se verifican coincidencias entre múltiples cuentas puede afirmarse que se trata de una botnet u otras redes de cuentas inauténticas, como las granjas de trolls o los equipos de astruturfing.

Etiquetar a una cuenta como falsa o “bot” únicamente porque “parece” sospechosa –especialmente si es anónima– es un error común y metodológicamente débil.

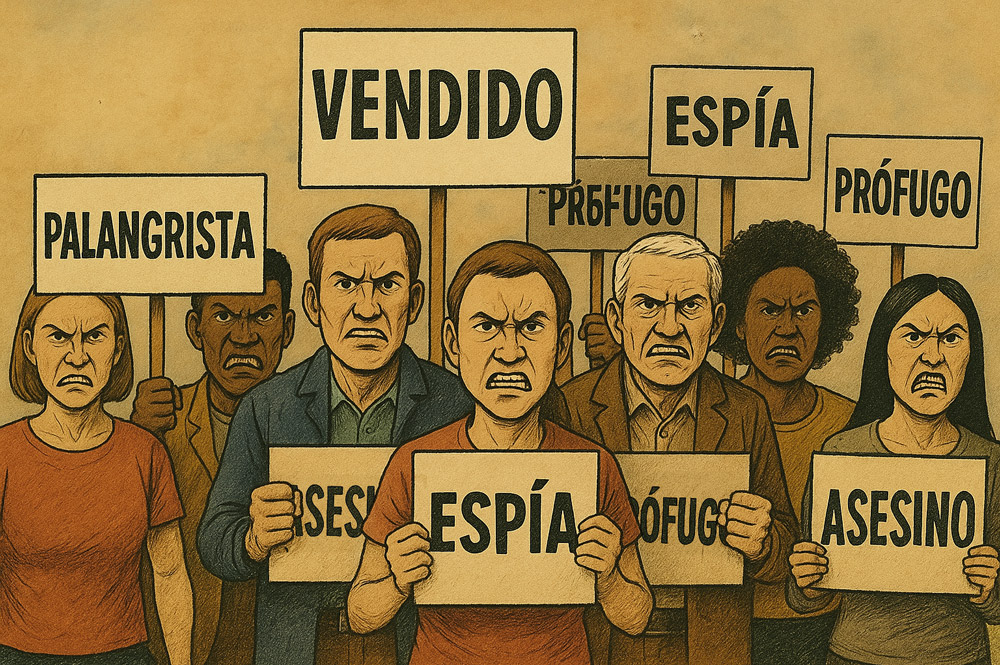

Las campañas de descrédito o difamación, representan otro tipo de campaña maliciosa.

Si se impulsan repetidamente, pueden formar parte de operaciones de influencia diseñadas para estigmatizar. En redes sociales, estas campañas suelen dirigirse contra periodistas, medios de comunicación y defensores de derechos humanos.

Su carácter malicioso busca debilitar la credibilidad de fuentes que ejercen su libertad de expresión para denunciar actos de corrupción, documentar hechos ilegales o exponer a funcionarios y, de ese modo, reducir el impacto de sus denuncias o de su trabajo de documentación.

Blanqueamiento, encubrimiento y falsas banderas

También existen campañas que aparentan ser espontáneas, pero en realidad están cuidadosamente organizadas para dar una imagen de respaldo popular que no existe.

En algunos casos se trata de campañas de “blanqueamiento”. Ocurren cuando un grupo de cuentas actúan como si fueran simpatizantes espontáneos de un actor, causa o narrativa, aunque realmente están coordinadas y vinculadas con ese mismo actor. No son más que “cheerleaders” digitales.

De esta forma, con el uso de propaganda y coordinación, buscan proyectar la ilusión de un gran respaldo popular en redes sociales con solo un grupo reducido de cuentas.

Esta falta de transparencia también convierte lo que podría parecer un apoyo genuino en una operación de influencia maliciosa. La idea no es simplemente participar en el debate público, sino amplificar artificialmente la narrativa de un actor para moldear la percepción y otorgar una legitimidad que no existe.

En algunos países, como Venezuela, se han detectado redes de cuentas —a veces anónimas, a veces con identidades completamente públicas y, en otras ocasiones, encubiertas— que impulsan campañas de blanqueamiento a favor de cuerpos policiales o militares.

Estas campañas utilizan propaganda digital enalteciendo los logros del cuerpo y, en algunos casos, despliegan campañas de estigmatización contra medios de comunicación, periodistas, militantes y organizaciones venezolanas que cuestionan sus acciones.

¿Pero qué sucede cuando no se tiene certeza de quién controla una red de cuentas que parecen reales?

Esta falta de transparencia en la autoría impide distinguir entre activismo legítimo y operaciones encubiertas, lo que crea un terreno fértil para la manipulación política a través de una estrategia particular: el uso de campañas de falsa bandera. En estas campañas existe actividad de cuentas que se hacen pasar por simpatizantes de un partido, pero que en realidad están dirigidas por el bando contrario y son usadas para desinformar.

En una misma red coordinada pueden coexistir perfiles que expresan apoyo al partido “azul” y otros —con fechas de creación, imágenes de perfil, estilo de escritura y patrones de seguidores casi idénticos— que aparentan simpatizar con el partido “rojo”. Esta contradicción a veces puede explicarse: el o los operadores utilizan cuentas creadas casi simultáneamente, con características similares, pero se reparten para impulsar distintos objetivos de la misma campaña: por un lado amplificar propaganda a favor de un bando y, por el otro, difundir desinformación que perjudique al adversario –incluso haciéndose pasar por cuentas del otro bando–.

Las campañas de falsa bandera suelen delatarse por patrones que permiten probar que las cuentas que las conforman están vinculadas: avatares muy parecidos, símbolos o hashtags compartidos, cuentas creadas en bloque durante lapsos cortos, biografías escuetas o vacías, horarios de publicación, lenguaje y muchos otros patrones. Analizarlos de manera conjunta a veces permite vincular los perfiles entre sí y confirmar su operación coordinada, aunque no es fácil lograrlo.

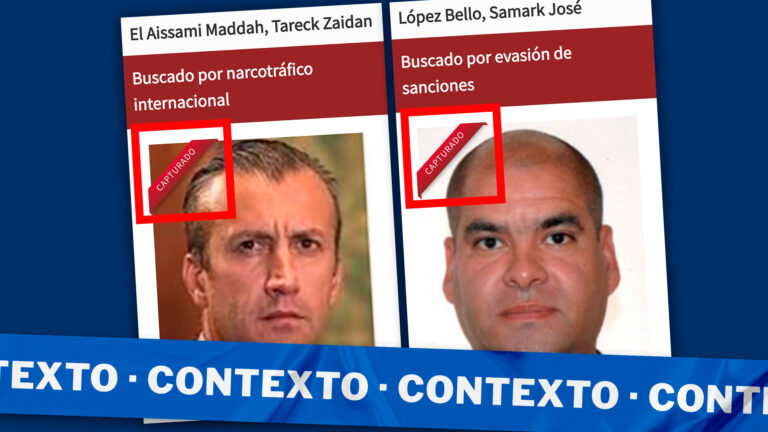

En Venezuela se pueden usar como ejemplos dos casos emblemáticos: parte de la red “TrollsVQ” (2021), la red “Falsos Comanditos” (2024) y un grupo de cuentas mostradas en rueda de prensa por el presidente de la Asamblea Nacional, Jorge Rodríguez, que identificó como cuentas violentas de oposición. En los tres casos, eran redes de cuentas falsas que se hacían pasar por opositores y difundían desinformación para minar la confianza en el voto, sabotear convocatorias a movilizaciones y estigmatizar a los simpatizantes de la oposición.

La experiencia venezolana demuestra que acusar al adversario de “usar bots” apenas roza la superficie de un fenómeno mucho más complejo.

Para determinar si una campaña digital es legítima o forma parte de una operación maliciosa, es necesario un análisis riguroso basado en evidencias: la calidad del contenido, la transparencia de las cuentas, los patrones de coordinación y los llamados a la acción son elementos clave. Solo así es posible diferenciar entre expresiones auténticas —incluso aquellas que recurren al anonimato por temor a represalias— y acciones inauténticas diseñadas para manipular la conversación pública.

Estas estrategias distorsionan la esfera pública, vulneran derechos digitales y erosionan la libertad de expresión. Reconocerlas y rechazarlas —sin importar su origen político— es una tarea urgente para la sociedad civil, las plataformas tecnológicas y los propios usuarios si se quiere defender un debate plural, libre e informado en internet.

Cazadores de Fake News investiga a detalle cada caso, mediante la búsqueda y el hallazgo de evidencias forenses digitales en fuentes abiertas. En algunos casos, se usan datos no disponibles en fuentes abiertas con el objetivo de reorientar las investigaciones o recolectar más evidencias.