¿Para qué existen las cuentas bot, cuáles son sus características y por qué no todas las que aparentan ser bots, lo son? Respondemos las preguntas más frecuentes con ejemplos venezolanos e internacionales

En internet, los bots son programas usados para realizar tareas, generar contenido o interactuar con otros usuarios, de forma automatizada, tal como lo hace el «piloto automático» de un avión. Según el Observatorio de palabras de la Real Academia Española, la palabra bot (que no es más que una abreviación de «robot«) es usada en referencia a «un programa informático que efectúa automáticamente determinadas tareas«.

En redes sociales como Twitter existen muchos tipos de bots y todos tienen el mismo factor común: realizan alguna acción sin la intervención, en tiempo real, de usuarios humanos.

El creador de un bot solo interviene al momento de su programación o creación y, ocasionalmente, en su mantenimiento o reprogramación. Establece las tareas que ejecuta el bot mediante un código, un script, widgets, secuencias de comandos o en general, cualquier software que defina su funcionamiento.

No todos los bots son malos

Los bots han sido usado en redes sociales desde sus primeros años de existencia. En el caso de Twitter, por ejemplo, se han publicado reportes sobre el uso de cuentas bots útiles, “buenos” al menos desde 2010.

Algunos han sido creados para realizar tareas no maliciosas, ni perjudiciales. Existen bots que son útiles para automatizar muchas tareas, entre ellas publicar automáticamente artículos de medios digitales, entregar alertas sobre actualizaciones de blogs, pronósticos del tiempo para alguna zona geográfica, descargar videos incrustados en tweets de otros usuarios, responder consultas de clientes de servicios públicos o bancos y, más recientemente, entregar avisos sobre la disponibilidad de la vacuna contra el COVID-19 en algún país.

A diferencia de lo que muchos creen, Twitter no está en contra de este tipo de “bots buenos“. De hecho, en 2021, propuso la implementación de una etiqueta especial, que le permita a sus usuarios identificar con facilidad a bots útiles, en un intento de que «se sientan más cómodos en su comprensión del espacio en el que interactúan«.

Pero en Twitter (al igual que en otras redes sociales) también existen cuentas bot “malas”, que publican contenido perjudicial: spam, propaganda, contenido falso, engañoso, que incita al odio o simplemente de tipo comercial (como la pornografía). Los creadores de este contenido pueden aprovecharse de las ventajas de la automatización, usando bots para amplificar su alcance y acelerar su propagación.

Haciendo una analogía con la pandemia del COVID-19: si la desinformación, la propaganda y el discurso de odio son el “virus”, los bots pueden convertise en sus “superpropagadores”. El contenido tóxico que amplifican de forma automática puede ocultar, eclipsar o aparentar ser más relevante que el generado de forma espontánea, “orgánica”, por millones de usuarios humanos en las redes sociales.

Por todo lo anterior, ciertos tipos de cuentas bot están prohibidas en la mayoría de las redes sociales y la acción de cierto tipo de cuentas bot tóxicas, indeseadas, es un gran desafío que las redes sociales intentan controlar.

¿Cuáles son las características de una cuenta bot?

No todas las cuentas bot tienen las mismas características y no todas las cuentas que se comportan como bots, están automatizadas —por lo tanto, no todas las que parecen bots, son bots—.

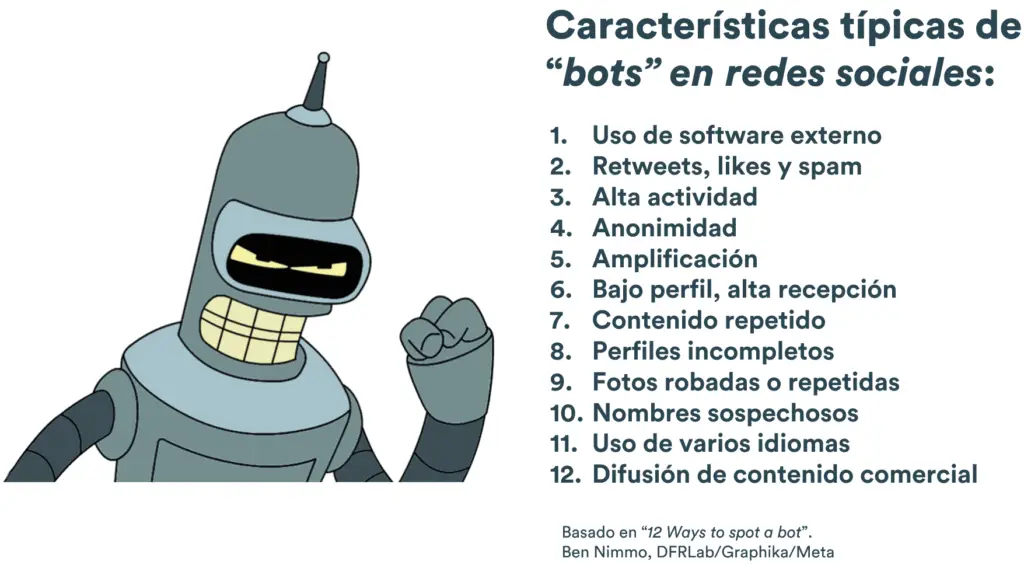

Sin embargo, algunos autores o investigadores han propuesto listas con características típicas que presentan muchas de las cuentas bots que suelen detectarse, especialmente en Twitter y con las que pueden identificarse, al menos de forma preliminar, cuentas con comportamiento similar a bot.

Una de las listas más difundidas con características típicas de cuentas bot en Twitter, fue propuesta por el investigador Ben Nimmo (DFRLab, Graphika, actualmente en Meta) en 2007. “Es la combinación de estos factores lo que importa”, reitera Nimmo, haciendo énfasis en que determinar que una cuenta sospechosa posee alguna o varias de estas características, no es razón suficiente para considerar que es una cuenta bot:

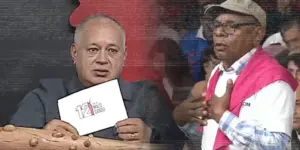

Algunas campañas impulsadas de forma no auténtica y coordinada en Venezuela, se valieron del uso de cuentas con varias de las características típicas de cuentas bot, enumeradas en el artículo de Nimmo.

Sin embargo, aunque las anteriores son características típicas de cuentas bot, gran cantidad de cuentas operadas por usuarios humanos, sin automatización, poseen uno o varios de dichas características. Adicionalmente, no todas las cuentas con una o varias de estas características están automatizadas, por lo tanto no pueden ser consideradas, en estricto rigor, bots.

¿Cómo saber si una cuenta (bot) está siendo automatizada?

Para afirmar con seguridad si una cuenta en redes sociales es un bot, es necesario comprobar que está automatizada.

En algunos casos, es una tarea sencilla. Basta usar herramientas online gratuitas como Account Analysis o TruthNest para detectar si sus tweets están siendo publicados mediante una aplicación especial, distinta a los clientes oficiales de Twitter para Android (Twitter for Android), Iphone (Twitter for Android), Ipad (Twitter for Ipad) o el cliente web, al que se accede desde un ordenador personal (Twitter Web App) y qué porcentaje de sus tweets han sido publicados con herramientas externas, entre las que se encuentran aplicaciones de escritorio, apps, scripts, códigos o secuencias de comandos.

Existen aplicaciones externas que son usadas para programar la publicación de tweets, como IFTTT, TweetDeck, Buffer o HootSuite. Aunque su uso no está prohibido por Twitter, pueden ser usadas por cuentas bot, útiles (“buenas”) o tóxicas (“malas”), para automatizar la publicación de gran variedad de tipos de contenido, que incluyen noticias o publicidad y también spam, desinformación, propaganda o contenido de odio.

Detectar patrones en los diagramas de publicación de tweets, puede llevarnos a concluir que alguna cuenta se encuentra automatizada. Y en los casos más evidentes, se puede usar la herramienta Allegedly para determinar si estos patrones existen.

Por ejemplo, hay cuentas bot que publican tweets todos los días en horas pares, cada dos horas, o en lotes de 10 tweets por hora. Hay otras que publican una cantidad constante de tweets durante todo el día, incluso de madrugada, denotando un comportamiento automatizado.

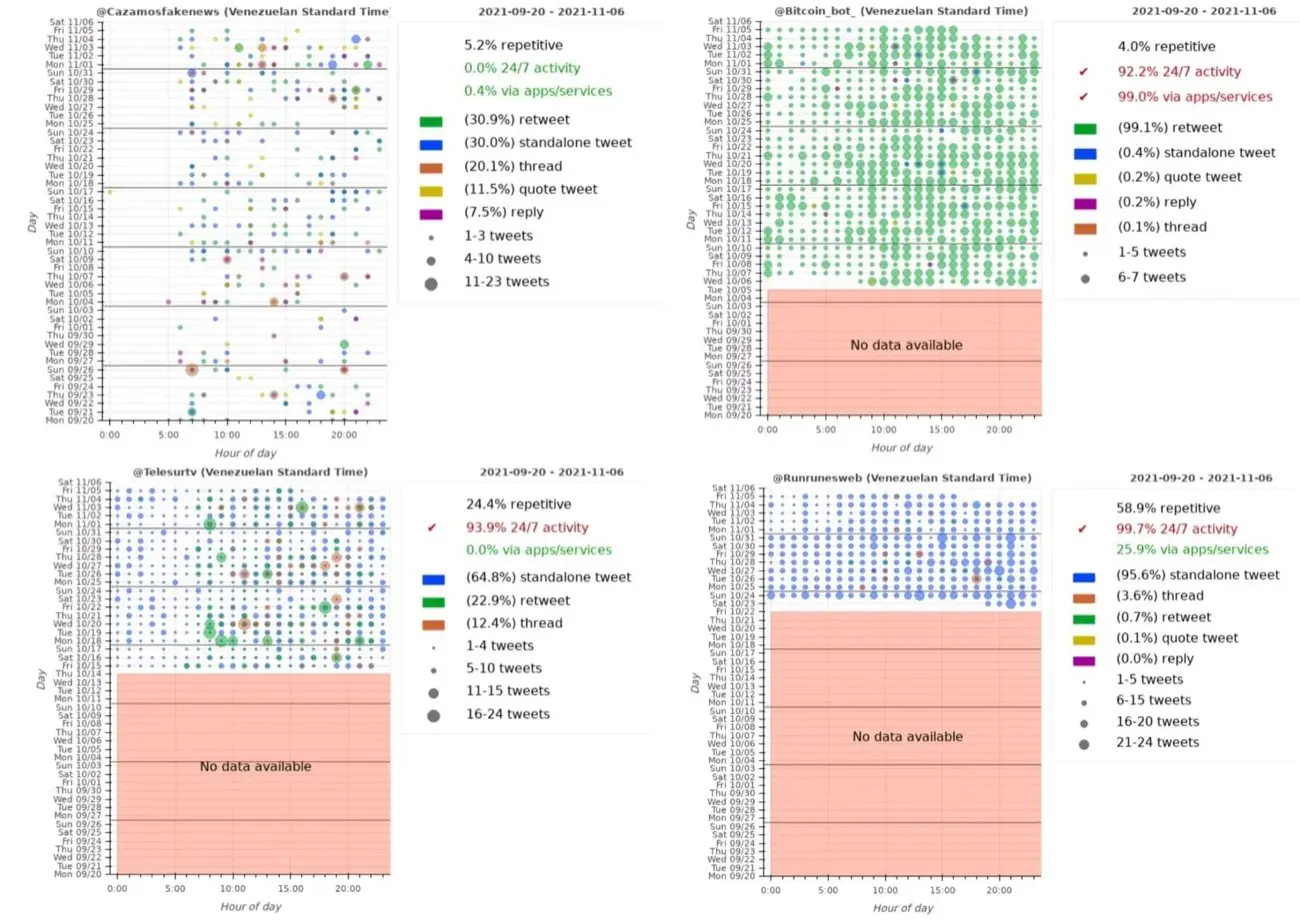

Los diagramas de publicación presentados a continuación son un ejemplo de cómo difieren los diagramas de publicación de tweets entre cuentas no automatizadas (humanas) y automatizadas (bots):

El diagrama de publicación de tweets de @cazamosfakenews es un ejemplo de cuenta no automatizada, presentada como control.

Los tres últimos diagramas pueden ser consideradas cuentas bots útiles o “buenas”: su contenido es generado simplemente para difundir contenido de interés del mundo de las criptomonedas (@bitcoin_bot) o sobre actualizaciones de noticias (@TelesurTV y @RunrunesWeb).

A diferencia de @cazamosfakenews, que no está automatizada, las restantes poseen un patrón de publicación de 24 horas al día, los 7 días de la semana, tuiteando al menos 5 tweets cada hora (a razón de 1 tweet cada 20 minutos, durante todo el día). Un patrón evidentemente automatizado.

Sin embargo, a veces no es tan sencillo demostrar que una cuenta está automatizada.

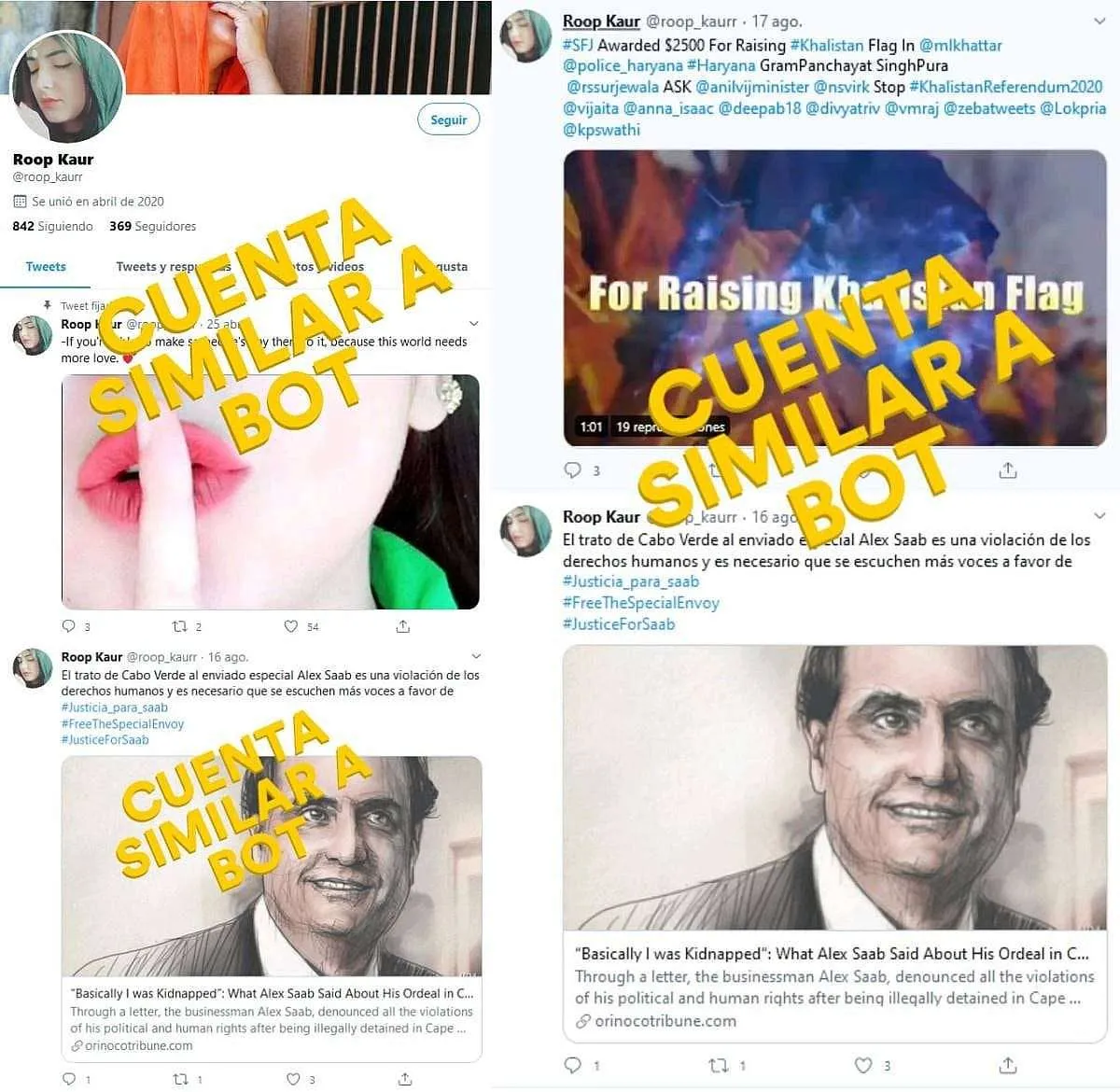

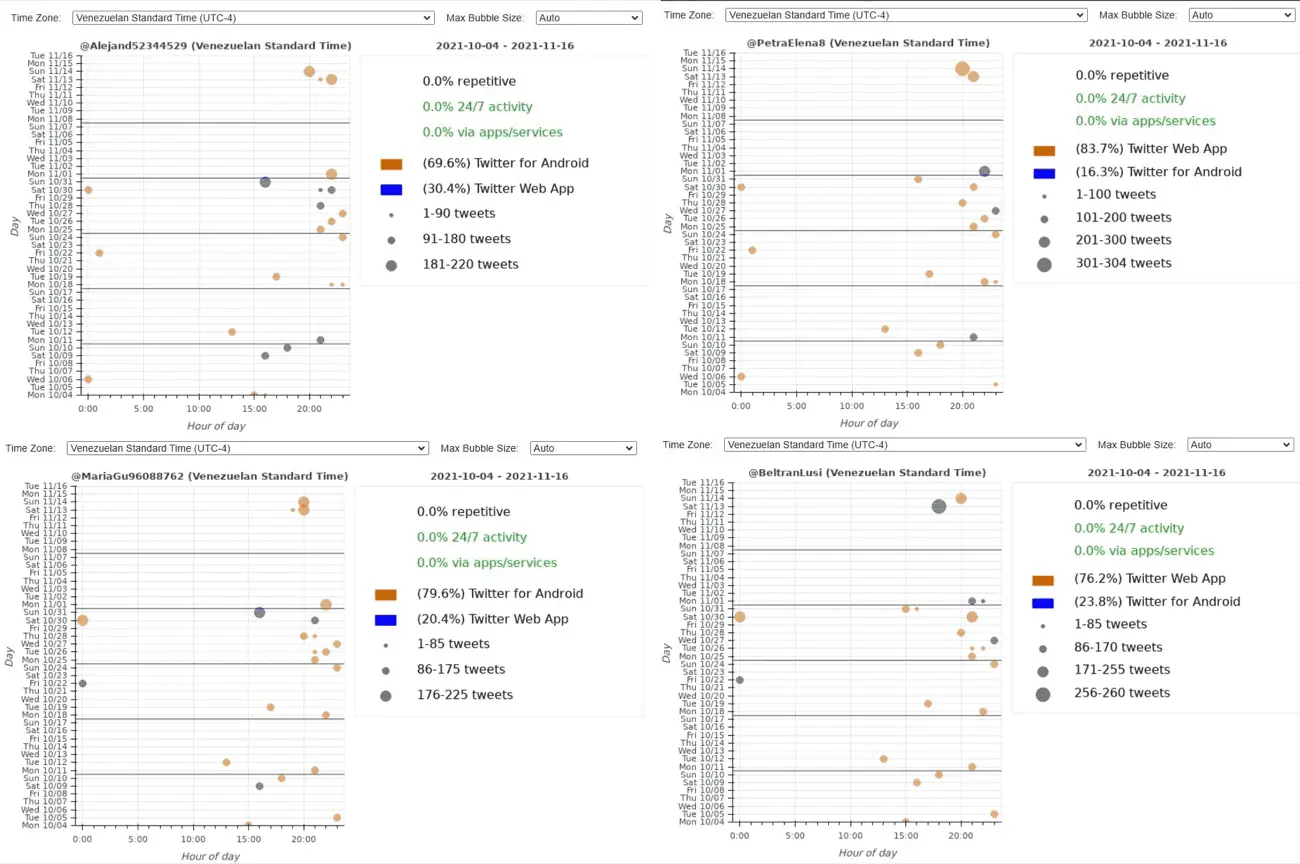

En un tutorial publicado en nuestra página web, usamos dos herramientas online (Allegedly y TweetBeaver) y una aplicación de escritorio de acceso gratuito (Tableau Public), para determinar si un grupo de cuentas tenían algún tipo de automatización. Desarrollamos un análisis detallado, paso a paso y no hallamos evidencias concluyentes sobre su automatización, aunque las cuentas poseían varias de las características típicas señaladas en el artículo de Ben Nimmo.

Por eso, las consideramos cuentas con un claro comportamiento “similar a bot”, aunque preferimos no llamarlas explícitamente “cuentas bot”, porque no pudimos demostrar su automatización.

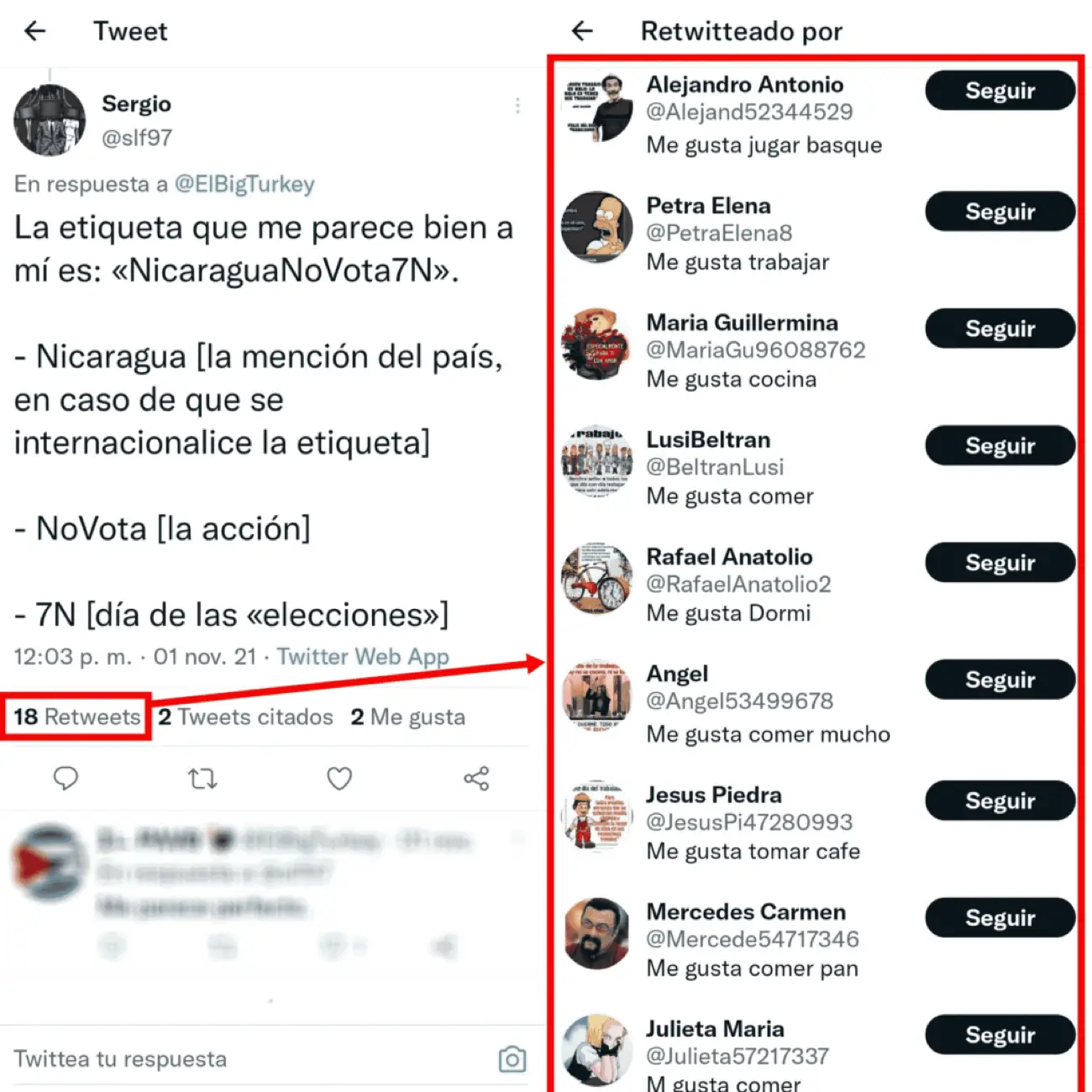

Botnets: cámaras de eco robotizadas

Existen casos particulares, en los que se programa la automatización de grupos de cuentas en redes sociales, con la intención de amplificar un mensaje específico, simulando de forma engañosa que es más popular de lo que realmente es —porque muchas cuentas lo comparten al mismo tiempo—. En estos casos, los mensajes son amplificados por una red de bots, o “botnet”, que opera básicamente como una cámara de eco para todos los mensajes que desea amplificar su creador u operador.

El siguiente es un ejemplo de botnet expuesto en Twitter por el investigador @conspirator0 en Twitter: una red con 136 bots japoneses, que generaban retweets de forma automática, mediante 36 aplicaciones especialmente diseñadas, con nombres de usuario similares. Fue usada para retuitear un tweet con una felicitación de cumpleaños al expresidente Donald Trump, que llevaba la etiqueta #Trump2020:

Las botnet pueden distorsionar profundamente la conversación online. Afortunadamente, las redes sociales son cada vez más efectivas detectando y restringiendo el contenido tóxico generado por botnets, que eran mucho más comunes hace algunos años.

En el caso especial de Twitter, el sistema proactivo de la red social intenta detectar automáticamente cuentas con comportamiento similar a bot o botnets y puede llegar a suspenderlas si determina que incumplen su Política en contra del spam y la manipulación de plataforma.

Algunos ejemplos de cuentas bot y botnets detectadas en Venezuela

- Botnet con cuentas semi-automatizadas que retuiteaban automáticamente contenido de Nicolás Maduro: mediante el uso de programas externos, un grupo de cuentas retuiteaban contenido propagandístico de los gobiernos de Hugo Chávez y Nicolás Maduro y en su última fase, solamente hacía retweets a Maduro. No todas las cuentas estaban totalmente automatizadas. El 2 de diciembre de 2021, Twitter divulgó una base de datos que incluía 18 cuentas de esta red; según estimaciones, la red pudo estar conformada por al menos 56 cuentas semi-automatizadas. Actualmente se encuentra fuera de línea.

- Red de cuentas con comportamiento similar a bot de la campaña de defensa de Alex Saab en Twitter: La mayoría de las cuentas de esta campaña, detectadas en 2020 y 2021, solían ser suspendidas en cuestión de días. El 2 de diciembre de 2021, Twitter divulgó una base de datos que incluía 18 cuentas de esta red. Se estima que existen al menos 167 cuentas activas con similares características.

- Botnet de Pornobots: botnet de Twitter con cuentas que simulan ser mujeres atractivas, que interactúan via Mensaje Directo con usuarios que hacen “me gusta” o responden a sus tweets, enviando eventualmente enlaces a páginas web donde se distribuye contenido pornográfico. En un artículo publicado en febrero de 2021, determinamos que la red estaba conformada al menos por 6031 cuentas diferentes.

- Botnet que retuiteaba contenido publicado por la página Dolar Today: red de cuentas semi-automatizadas que retuiteaban automáticamente contenido publicado por la página web Dolar Today, mediante una aplicación externa llamada “SWAT Comunicacional”, que podía ser instalada voluntariamente por los lectores del portal. Reportada en 2017 por la investigadora Erin Gallagher. Actualmente se encuentra fuera de línea.

Cazadores de Fake News investiga cada caso mediante la búsqueda y el hallazgo de evidencias forenses digitales en fuentes abiertas. En algunos casos, se usan datos no disponibles en fuentes abiertas con el objetivo de reorientar las investigaciones o recolectar más evidencias.

Ver metodología